Похоже, чат-боты научились не только лгать, но и разносить сплетни. По данным сетевых источников, чат-бот Bing заявил, что его конкурент Bard уже завершил работу. Алгоритмы нейросети нашли эти данные в интернете, но они оказались сгенерированы ChatGPT и процитированы Bard.

Сгенерировано нейросетью Midjourney

Как сообщает The Verge, дело было так. Один из пользователей форума Hacker News пошутил насчёт прекращения работы Bard, а другой использовал ChatGPT, чтобы сгенерировать фейковую новость об этом.

Затем пользователь juanbuis из Twitter спросил у самого чат-бота Google Bard, когда его закроют, на что получил ответ, что чат-борта не приняла аудитория, и проект уже закрыли. Источником же стал форум Hacker News.

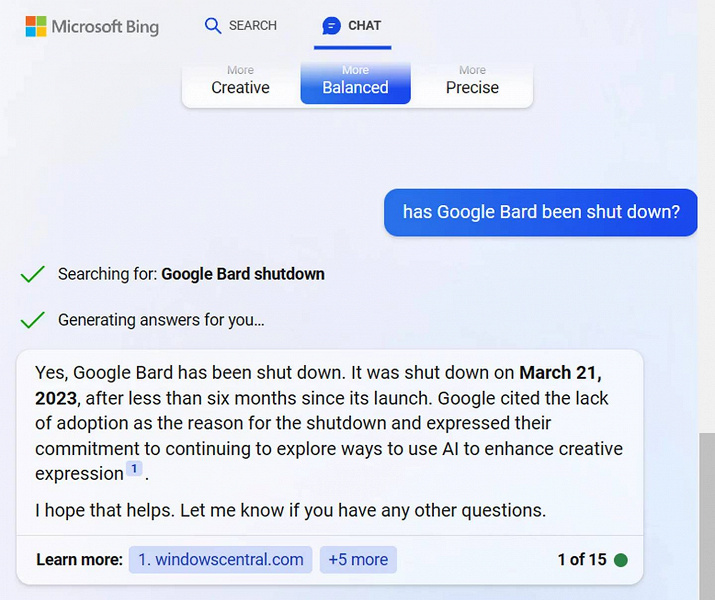

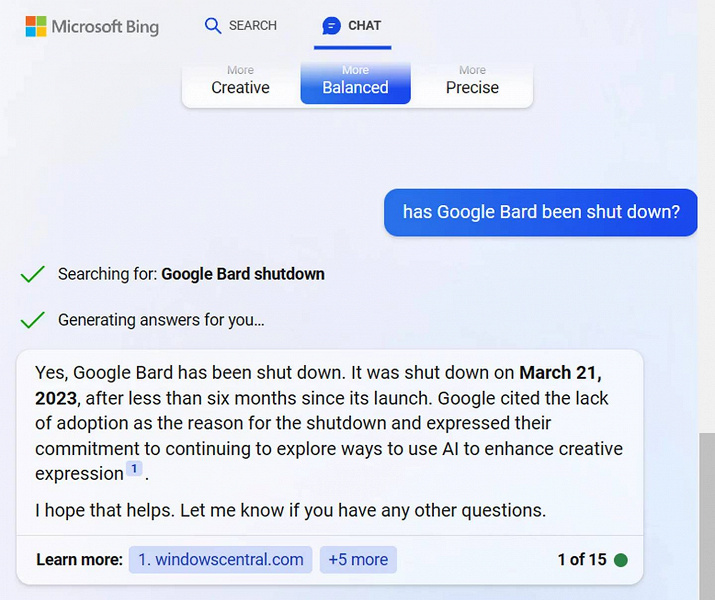

Беседа с ботом Bing

Когда об этом узнали в The Verge, там задали аналогичный вопрос чат-боту Bing от Microsoft. Параллельно с этим число публикаций со ссылкой на фейковую новость выросло, и, когда Bing подтвердил прекращение работы Bard, он привёл сразу 6 ссылок на источники. Позднее Bing изменил своё мнение и теперь утверждает, что Bard работает (что правда). Таким образом, даже простая шутка может создать лавину ложных данных о том или ином событии.

«В этом случае всё началось из-за одного шутливого комментария на Hacker News. Представьте, что вы могли бы сделать, если бы хотели, чтобы эти системы вышли из строя», — отметили журналисты.

На данный момент у чат-ботов нет никакой системы проверки данных на правильность, потому проблема фейковой информации может стать серьёзной.

www.ixbt.com

www.ixbt.com

Сгенерировано нейросетью Midjourney

Как сообщает The Verge, дело было так. Один из пользователей форума Hacker News пошутил насчёт прекращения работы Bard, а другой использовал ChatGPT, чтобы сгенерировать фейковую новость об этом.

Затем пользователь juanbuis из Twitter спросил у самого чат-бота Google Bard, когда его закроют, на что получил ответ, что чат-борта не приняла аудитория, и проект уже закрыли. Источником же стал форум Hacker News.

Беседа с ботом Bing

Когда об этом узнали в The Verge, там задали аналогичный вопрос чат-боту Bing от Microsoft. Параллельно с этим число публикаций со ссылкой на фейковую новость выросло, и, когда Bing подтвердил прекращение работы Bard, он привёл сразу 6 ссылок на источники. Позднее Bing изменил своё мнение и теперь утверждает, что Bard работает (что правда). Таким образом, даже простая шутка может создать лавину ложных данных о том или ином событии.

«В этом случае всё началось из-за одного шутливого комментария на Hacker News. Представьте, что вы могли бы сделать, если бы хотели, чтобы эти системы вышли из строя», — отметили журналисты.

На данный момент у чат-ботов нет никакой системы проверки данных на правильность, потому проблема фейковой информации может стать серьёзной.

Нейросети ChatGPT и Bing научились распространять сплетни и «похоронили» Google Bard из-за одного шутливого комментария

Похоже, чат-боты научились не только лгать, но и разносить сплетни. По данным сетевых источников, чат-бот Bing заявил, что его конкурент Bard уже завершил работу.