В данной статье хочу рассмотреть банальный и несложный проект, а именно подсчет количества поднятых пальцев.

Все исходники можно найти на моем Github.

Код будем рассматривать с самого начала, но лучше всего ознакомиться с моими предыдущими статьями.

Подготавливаем среду и устанавливаем следующие библиотеки:

pip install mediapipe

pip install opencv-python

pip install math

Создаем файл HandTrackingModule.py с привычным для моих читателей классом handDetector:

import cv2

import mediapipe as mp

import time

import math

class handDetector():

def __init__(self, mode=False, maxHands=2, modelComplexity=1, detectionCon=0.5, trackCon=0.5):

self.mode = mode

self.maxHands = maxHands

self.modelComplexity = modelComplexity

self.detectionCon = detectionCon

self.trackCon = trackCon

self.mpHands = mp.solutions.hands

self.hands = self.mpHands.Hands(self.mode, self.maxHands, self.modelComplexity, self.detectionCon, self.trackCon)

self.mpDraw = mp.solutions.drawing_utils

self.tipIds = [4, 8, 12, 16, 20]

def findHands(self, img, draw=True):

imgRGB = cv2.cvtColor(img, cv2.COLOR_BGR2RGB)

self.results = self.hands.process(imgRGB)

#print(results.multi_hand_landmarks)

if self.results.multi_hand_landmarks:

for handLms in self.results.multi_hand_landmarks:

if draw:

self.mpDraw.draw_landmarks(img, handLms, self.mpHands.HAND_CONNECTIONS)

return img

def findPosition(self, img, handNo=0, draw=True):

xList = []

yList = []

bbox = []

self.lmList = []

if self.results.multi_hand_landmarks:

myHand = self.results.multi_hand_landmarks[handNo]

for id, lm in enumerate(myHand.landmark):

#print(id, lm)

h, w, c = img.shape

cx, cy = int(lm.x*w), int(lm.y*h)

xList.append(cx)

yList.append(cy)

#print(id, cx, cy)

self.lmList.append([id, cx, cy])

if draw:

cv2.circle(img, (cx, cy), 5, (255,0,255), cv2.FILLED)

xmin, xmax = min(xList), max(xList)

ymin, ymax = min(yList), max(yList)

bbox = xmin, ymin, xmax, ymax

if draw:

cv2.rectangle(img, (bbox[0]-20, bbox[1]-20), (bbox[2]+20, bbox[3]+20), (0, 255, 0), 2)

return self.lmList, bbox

def findDistance(self, p1, p2, img, draw=True):

x1, y1 = self.lmList[p1][1], self.lmList[p1][2]

x2, y2 = self.lmList[p2][1], self.lmList[p2][2]

cx, cy = (x1+x2)//2, (y1+y2)//2

if draw:

cv2.circle(img, (x1,y1), 15, (255,0,255), cv2.FILLED)

cv2.circle(img, (x2,y2), 15, (255,0,255), cv2.FILLED)

cv2.line(img, (x1,y1), (x2,y2), (255,0,255), 3)

cv2.circle(img, (cx,cy), 15, (255,0,255), cv2.FILLED)

length = math.hypot(x2-x1, y2-y1)

return length, img, [x1, y1, x2, y2, cx, cy]

def fingersUp(self):

fingers = []

# Thumb

if self.lmList[self.tipIds[0]][1] < self.lmList[self.tipIds[0]-1][1]:

fingers.append(1)

else:

fingers.append(0)

# 4 Fingers

for id in range(1,5):

if self.lmList[self.tipIds[id]][2] < self.lmList[self.tipIds[id]-2][2]:

fingers.append(1)

else:

fingers.append(0)

return fingers

def main():

pTime = 0

cTime = 0

cap = cv2.VideoCapture(0)

detector = handDetector()

while True:

success, img = cap.read()

img = detector.findHands(img)

lmList = detector.findPosition(img)

if len(lmList) != 0:

print(lmList[1])

cTime = time.time()

fps = 1. / (cTime - pTime)

pTime = cTime

cv2.putText(img, str(int(fps)), (10,70), cv2.FONT_HERSHEY_PLAIN, 3, (255,0,255), 3)

cv2.imshow("Image", img)

cv2.waitKey(1)

if __name__ == "__main__":

main()

Данный класс является шаблонным и я его всегда использую в своих проектах, связанных с OpenCV.

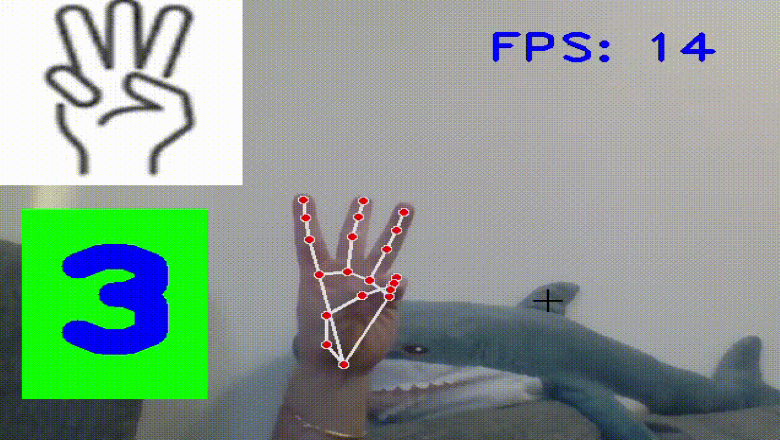

Подготовим исходники. Скачаем изображения с Github и поместим их в папку fingers. Посмотрим на их названия, логика тут простая - изображение называется <num>.jpg, где num - количество поднятых пальцев.

Создадим новый файл main.py и импортируем библиотеки:

import cv2

import time

import os

import HandTrackingModule as htm

Подключаем камеру:

wCam, hCam = 640, 480

cap = cv2.VideoCapture(0)

cap.set(3, wCam)

cap.set(4, hCam)

При подключении камеры могут возникнуть ошибки, поменяйте 0 из `cap = cv2.VideoCapture(0)` на 1 или 2.

Получаем все изображения:

folderPath = "fingers" # name of the folder, where there are images of fingers

fingerList = os.listdir(folderPath) # list of image titles in 'fingers' folder

overlayList = []

for imgPath in fingerList:

image = cv2.imread(f'{folderPath}/{imgPath}')

overlayList.append(image)

Объявляем дополнительные переменные:

pTime = 0

detector = htm.handDetector(detectionCon=0.75, maxHands=1)

totalFingers = 0

Запускаем бесконечный цикл (можно добавить остановку, если требуется), запускаем камеру и начинаем отслеживать руку в кадре:

while True:

sucess, img = cap.read()

img = cv2.flip(img, 1)

img = detector.findHands(img)

lmList, bbox = detector.findPosition(img, draw=False)

Если список с позициями руки не пустой, то считаем количество поднятых пальцев:

if lmList:

fingersUp = detector.fingersUp()

totalFingers = fingersUp.count(1)

Также будем выводить изображение, соответствующее количеству поднятых пальцев:

h, w, c = overlayList[totalFingers].shape

img[0:h, 0:w] = overlayList[totalFingers]

И последнее, считаем FPS и выводим надписи в окне:

cTime = time.time()

fps = 1/ (cTime-pTime)

pTime = cTime

cv2.putText(img, f'FPS: {int(fps)}', (400, 70), cv2.FONT_HERSHEY_PLAIN, 3, (255, 0, 0), 3)

cv2.rectangle(img, (20, 225), (170, 425), (0, 255, 0), cv2.FILLED)

cv2.putText(img, str(totalFingers), (45, 375), cv2.FONT_HERSHEY_PLAIN, 10, (255, 0, 0), 25)

cv2.imshow("Image", img)

cv2.waitKey(1)

Запускаем программу и тестируем:

Все работает

habr.com

habr.com

Все исходники можно найти на моем Github.

Код будем рассматривать с самого начала, но лучше всего ознакомиться с моими предыдущими статьями.

Подготавливаем среду и устанавливаем следующие библиотеки:

pip install mediapipe

pip install opencv-python

pip install math

Создаем файл HandTrackingModule.py с привычным для моих читателей классом handDetector:

import cv2

import mediapipe as mp

import time

import math

class handDetector():

def __init__(self, mode=False, maxHands=2, modelComplexity=1, detectionCon=0.5, trackCon=0.5):

self.mode = mode

self.maxHands = maxHands

self.modelComplexity = modelComplexity

self.detectionCon = detectionCon

self.trackCon = trackCon

self.mpHands = mp.solutions.hands

self.hands = self.mpHands.Hands(self.mode, self.maxHands, self.modelComplexity, self.detectionCon, self.trackCon)

self.mpDraw = mp.solutions.drawing_utils

self.tipIds = [4, 8, 12, 16, 20]

def findHands(self, img, draw=True):

imgRGB = cv2.cvtColor(img, cv2.COLOR_BGR2RGB)

self.results = self.hands.process(imgRGB)

#print(results.multi_hand_landmarks)

if self.results.multi_hand_landmarks:

for handLms in self.results.multi_hand_landmarks:

if draw:

self.mpDraw.draw_landmarks(img, handLms, self.mpHands.HAND_CONNECTIONS)

return img

def findPosition(self, img, handNo=0, draw=True):

xList = []

yList = []

bbox = []

self.lmList = []

if self.results.multi_hand_landmarks:

myHand = self.results.multi_hand_landmarks[handNo]

for id, lm in enumerate(myHand.landmark):

#print(id, lm)

h, w, c = img.shape

cx, cy = int(lm.x*w), int(lm.y*h)

xList.append(cx)

yList.append(cy)

#print(id, cx, cy)

self.lmList.append([id, cx, cy])

if draw:

cv2.circle(img, (cx, cy), 5, (255,0,255), cv2.FILLED)

xmin, xmax = min(xList), max(xList)

ymin, ymax = min(yList), max(yList)

bbox = xmin, ymin, xmax, ymax

if draw:

cv2.rectangle(img, (bbox[0]-20, bbox[1]-20), (bbox[2]+20, bbox[3]+20), (0, 255, 0), 2)

return self.lmList, bbox

def findDistance(self, p1, p2, img, draw=True):

x1, y1 = self.lmList[p1][1], self.lmList[p1][2]

x2, y2 = self.lmList[p2][1], self.lmList[p2][2]

cx, cy = (x1+x2)//2, (y1+y2)//2

if draw:

cv2.circle(img, (x1,y1), 15, (255,0,255), cv2.FILLED)

cv2.circle(img, (x2,y2), 15, (255,0,255), cv2.FILLED)

cv2.line(img, (x1,y1), (x2,y2), (255,0,255), 3)

cv2.circle(img, (cx,cy), 15, (255,0,255), cv2.FILLED)

length = math.hypot(x2-x1, y2-y1)

return length, img, [x1, y1, x2, y2, cx, cy]

def fingersUp(self):

fingers = []

# Thumb

if self.lmList[self.tipIds[0]][1] < self.lmList[self.tipIds[0]-1][1]:

fingers.append(1)

else:

fingers.append(0)

# 4 Fingers

for id in range(1,5):

if self.lmList[self.tipIds[id]][2] < self.lmList[self.tipIds[id]-2][2]:

fingers.append(1)

else:

fingers.append(0)

return fingers

def main():

pTime = 0

cTime = 0

cap = cv2.VideoCapture(0)

detector = handDetector()

while True:

success, img = cap.read()

img = detector.findHands(img)

lmList = detector.findPosition(img)

if len(lmList) != 0:

print(lmList[1])

cTime = time.time()

fps = 1. / (cTime - pTime)

pTime = cTime

cv2.putText(img, str(int(fps)), (10,70), cv2.FONT_HERSHEY_PLAIN, 3, (255,0,255), 3)

cv2.imshow("Image", img)

cv2.waitKey(1)

if __name__ == "__main__":

main()

Данный класс является шаблонным и я его всегда использую в своих проектах, связанных с OpenCV.

Подготовим исходники. Скачаем изображения с Github и поместим их в папку fingers. Посмотрим на их названия, логика тут простая - изображение называется <num>.jpg, где num - количество поднятых пальцев.

Создадим новый файл main.py и импортируем библиотеки:

import cv2

import time

import os

import HandTrackingModule as htm

Подключаем камеру:

wCam, hCam = 640, 480

cap = cv2.VideoCapture(0)

cap.set(3, wCam)

cap.set(4, hCam)

При подключении камеры могут возникнуть ошибки, поменяйте 0 из `cap = cv2.VideoCapture(0)` на 1 или 2.

Получаем все изображения:

folderPath = "fingers" # name of the folder, where there are images of fingers

fingerList = os.listdir(folderPath) # list of image titles in 'fingers' folder

overlayList = []

for imgPath in fingerList:

image = cv2.imread(f'{folderPath}/{imgPath}')

overlayList.append(image)

Объявляем дополнительные переменные:

pTime = 0

detector = htm.handDetector(detectionCon=0.75, maxHands=1)

totalFingers = 0

Запускаем бесконечный цикл (можно добавить остановку, если требуется), запускаем камеру и начинаем отслеживать руку в кадре:

while True:

sucess, img = cap.read()

img = cv2.flip(img, 1)

img = detector.findHands(img)

lmList, bbox = detector.findPosition(img, draw=False)

Если список с позициями руки не пустой, то считаем количество поднятых пальцев:

if lmList:

fingersUp = detector.fingersUp()

totalFingers = fingersUp.count(1)

Также будем выводить изображение, соответствующее количеству поднятых пальцев:

h, w, c = overlayList[totalFingers].shape

img[0:h, 0:w] = overlayList[totalFingers]

И последнее, считаем FPS и выводим надписи в окне:

cTime = time.time()

fps = 1/ (cTime-pTime)

pTime = cTime

cv2.putText(img, f'FPS: {int(fps)}', (400, 70), cv2.FONT_HERSHEY_PLAIN, 3, (255, 0, 0), 3)

cv2.rectangle(img, (20, 225), (170, 425), (0, 255, 0), cv2.FILLED)

cv2.putText(img, str(totalFingers), (45, 375), cv2.FONT_HERSHEY_PLAIN, 10, (255, 0, 0), 25)

cv2.imshow("Image", img)

cv2.waitKey(1)

Запускаем программу и тестируем:

Все работает

Распознавание поднятых пальцев на Python+OpenCV

В данной статье хочу рассмотреть банальный и несложный проект, а именно подсчет количества поднятых пальцев. Все исходники можно найти на моем Github . Код будем рассматривать с самого начала, но...